Как обеспокоенный родитель и пользователь Apple на протяжении более двух десятилетий, я считаю, что недавнее объявление об улучшенной функции безопасности общения в iOS 18.2 является столь необходимым шагом вперед в области цифровой безопасности. Воспитывая своих детей в эпоху цифровых технологий, я могу засвидетельствовать проблемы и проблемы, связанные с навигацией в онлайн-пространстве.

В отчете указано, что будут включать в себя эти отчеты:

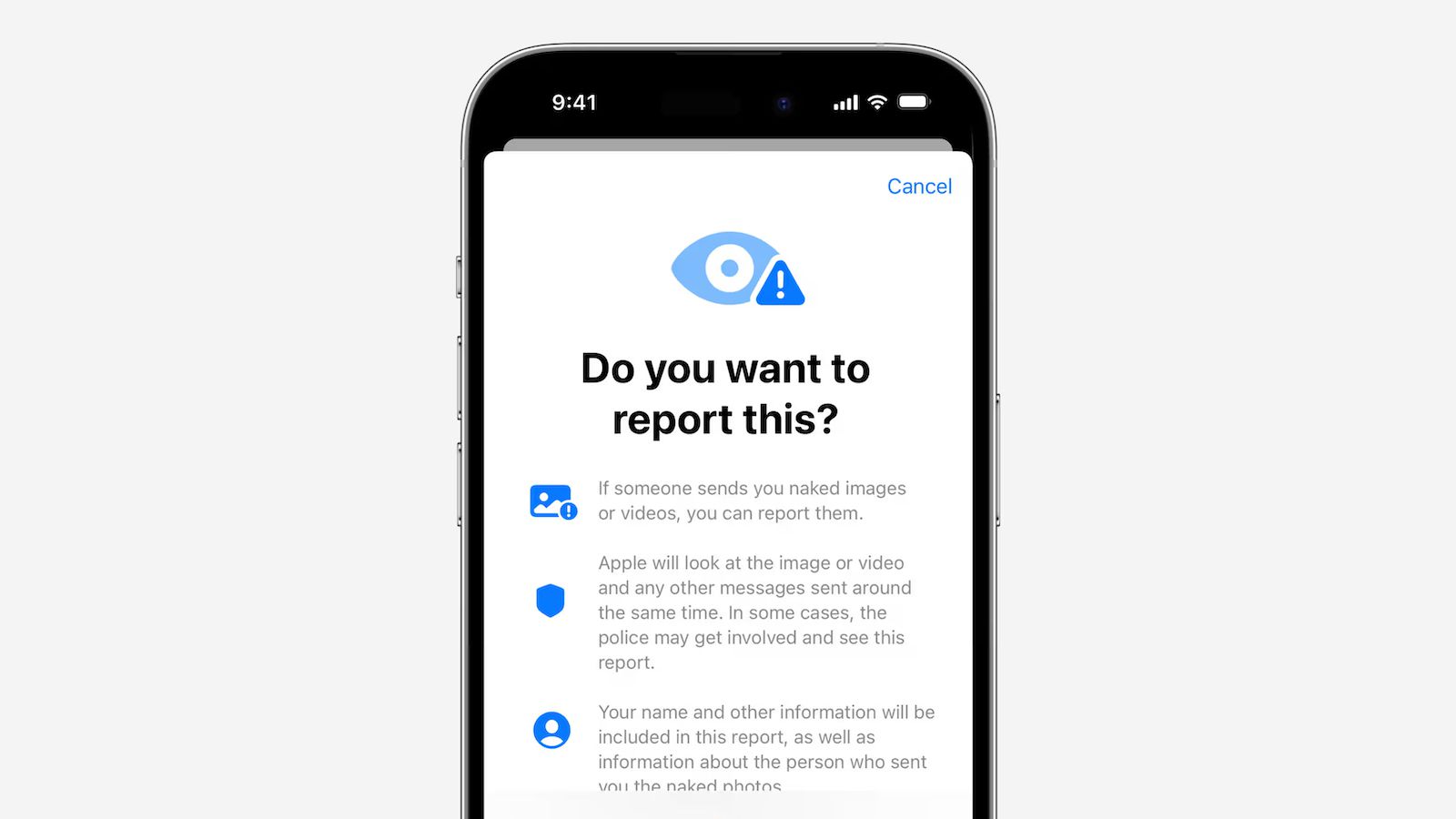

Гаджет создаст отчет, включающий изображения и видео, а также сообщения, которыми обменивались непосредственно перед этими медиа-элементами и после них. В этом отчете также будут указаны контактные данные обоих вовлеченных аккаунтов. Затем пользователи могут отправить форму с подробным описанием произошедших событий.

К концу 2024 года технологические компании, такие как Apple, должны внедрить более надежные стратегии по предотвращению материалов о сексуальном насилии над детьми (CSAM) на своих платформах после введения в Австралии новых правил, как указано в отчете.

Как восторженный поклонник, я очень рад новости о том, что Apple намерена в конечном итоге внедрить эту замечательную функцию во всем мире, согласно отчетам. К сожалению, они пока не назвали конкретные сроки его глобального выпуска.

Начиная с выпуска iOS 15.2 в 2021 году, функция Apple Communication Safety для iMessage была расширена в США. С выходом iOS 17 в прошлом году эта функциональность была расширена по всему миру и автоматически активировалась для детей в возрасте до 13 лет, у которых есть учетная запись Apple, которые принадлежат к группе «Семейный доступ» и вошли в систему.

Как аналитик, я бы перефразировал это так: я обсуждаю безопасность связи Apple, инструмент, который предупреждает детей, когда они обмениваются iMessages с откровенным содержанием. Эта мера безопасности действует исключительно на самом устройстве в целях обеспечения конфиденциальности. Оно распространяется на контент AirDrop, видеосообщения FaceTime и плакаты с контактами в приложении «Телефон». Если родители предпочитают отключить эту функцию на устройстве своего ребенка, они могут сделать это в приложении «Настройки» в разделе «Экранное время».

Как технический энтузиаст, я воодушевлен недавним событием, когда Apple отказалась от своего спорного плана по сканированию фотографий iCloud на предмет материалов о сексуальном насилии над детьми (CSAM) еще в 2022 году. Теперь они представили альтернативную функцию — сообщение об обнаженных телах. опция, которая позволяет таким пользователям, как я, отмечать потенциально конфиденциальный контент, обеспечивая более безопасную онлайн-среду без ущерба для конфиденциальности.

Вчера предварительная версия iOS 18.2 стала доступна для устройств с интеллектуальными возможностями Apple. Сюда входят серия iPhone 15 Pro и все модели iPhone 16. Ожидается, что это обновление программного обеспечения будет распространено среди более широкой аудитории в декабре.

Имейте в виду, что, поскольку тема этого обсуждения затрагивает политические или социальные вопросы, его можно найти в нашем разделе «Политические новости». Хотя всем предлагается читать и участвовать в беседе, только зарегистрированные пользователи, имеющие минимум 100 сообщений, могут публиковать ответы.

Смотрите также

- Объяснение концовки «Посева» (2024) – Какова «цель» Уиндема?

- Продлили ли «Антрацит» на 2 сезон? Вот что мы знаем:

- Рецензия на фильм «От нуля до героя» (2024) – бессовестно бессмысленная, но приятная романтическая комедия

- Обзор Bowers & Wilkins Pi8: наушники с великолепным звучанием и поддержкой aptX

- Где сейчас заключенные? | Как показано в сериале Netflix «Разблокировано: тюремный эксперимент».

- Что делать, если вы не можете открыть только что установленное приложение в macOS Sequoia

- iOS 26 предлагает полную анимацию обложки альбома на экране блокировки iPhone

- Сожаление фанатам Siri, не ожидайте эти отложенные функции Apple Intelligence до 2026 года.

- Обзор: FusionDock Max 1 от iVANKY обеспечивает исключительную универсальность благодаря двойному разъему Thunderbolt

- Практический опыт работы с новым iPad Mini 7

2024-10-24 18:00